L’argomento AI è molto caldo e negli ultimi giorni tiene banco la querelle sul blocco di ChatGPT in Italia.

Insieme alle polemiche sull’accessibilità o meno di questa tecnologia, si discute molto sul ruolo sempre più importante che le AI hanno nelle nostre vite.

In questo articolo non entrerò nel merito della sensatezza o meno della decisione presa dal Garante, su cui si stanno già spendendo fiumi d’inchiostro – reale e virtuale.

Voglio raccontarvi un po’ di come funzionano le AI e mettere a fuoco dei punti di riflessione importanti sul perché non sono intelligenti come vengono dipinte.

Che cos’è l’intelligenza

Si è pensato, a fasi alterne nella ricerca scientifica, che il cervello umano fosse riproducibile artificialmente perché, in concreto, è formato da neuroni che scambiano segnali elettrici. Questo significa che, in teoria, è possibile costruire dei neuroni artificiali interconnessi che, sulla base di quello che sappiamo del funzionamento del cervello (del modo in cui apprende, ricorda, rielabora) potremmo costruirne uno artificiale che sia pari – se non addirittura superiore – ad uno umano.

Lasciate che vi rassicuri: non è proprio così. Quantomeno non al momento (mi riservo eventualmente di rivedere la cosa dopo l’introduzione dei computer quantistici).

L’intelligenza non è un mero “saper far di conto”, che è quello che fa un’AI ad oggi, che traduce ed interpreta tutto sulla base di modelli matematici ed algoritmi.

Le ricerche psicologiche e neuroscientifiche hanno identificato almeno 12 tipi di “intelligenze” diverse proprie dell’essere umano:

- logico-matematica

- corporeo-cinestesica

- spaziale

- esistenziale

- intrapersonale

- interpersonale

- naturalistica

- musicale

- emotiva

- linguistica

- creativa

- collaborativa

Considerando che l’AI è ferma, bene che vada, alla prima, direi che iniziamo a intravvedere come non sia tutto oro quel che luccica: l’AI ha dei limiti enormi rispetto alle capacità di un cervello umano e lo scenario del “ci soppianteranno” è piuttosto lontano.

Un mondo stabile

Il limite, per ora non valicato, dell’AI (anche nel caso delle più avanzate Reti Neurali Profonde), è essenzialmente uno: le AI sono grandemente limitate nella gestione degli imprevisti, cosa che un essere umano fa milioni di volte al giorno senza neanche rendersene conto.

Un’AI, per funzionare bene, oltre ad acquisire molte informazioni, deve “muoversi” all’interno di una “realtà” in cui le regole siano stabilite e gli imprevisti quasi nulli. Il cosiddetto “mondo stabile”.

All’interno di un contesto rigidamente matematico (o “algoritmizzabile”), l’AI dà il suo meglio.

L’esempio classico sono gli scacchi: una volta imparate le regole, un’AI è imbattibile, ma è un perimetro di applicazione molto ristretto, regolato da modelli matematici prevedibili e oltretutto stabili nel tempo.

L’abbiamo visto all’opera anche con gli algoritmi di ChatGPT, in grado di simulare molto bene il linguaggio umano: ma cosa fa davvero ChatGPT? Genera sul serio risposte creative?

No, ChatGPT è un sofisticatissimo motore di ricerca che oltre a scovare le risposte è in grado di dare una formulazione scritta rispetto a domande specifiche, ma si tratta pur sempre di dati, numeri, schemi, pattern, regole. ALGORITMI. Sofisticatissimi, ma pure sempre strettamente matematici, tanto efficienti quanto aggirabili.

Le AI e la guida spericolata

Guidare un’auto per una strada trafficata, per quanto a noi appaia come un’operazione semplice, è in realtà estremamente complessa: coinvolge non solo le capacità tecniche di guida (come girare il volante, che è banale), ma ci impegna ogni istante in previsioni basate su euristiche decisionali che non sono alla portata di un’AI, non ultime quelle che attengono alla morale. Dal riconoscere immediatamente gli oggetti e il paesaggio intorno a noi (distinguere un bambino da un sacco abbandonato sul ciglio della strada, ad esempio), alla previsione di come si muoveranno questi oggetti (un bambino per mano ad un adulto difficilmente “scapperà” in mezzo alla corsia, uno da solo è più probabile che lo faccia), al prendere decisioni eticamente rilevanti. Le AI sono drammaticamente inadatte negli sceneri ad alta imprevedibilità.

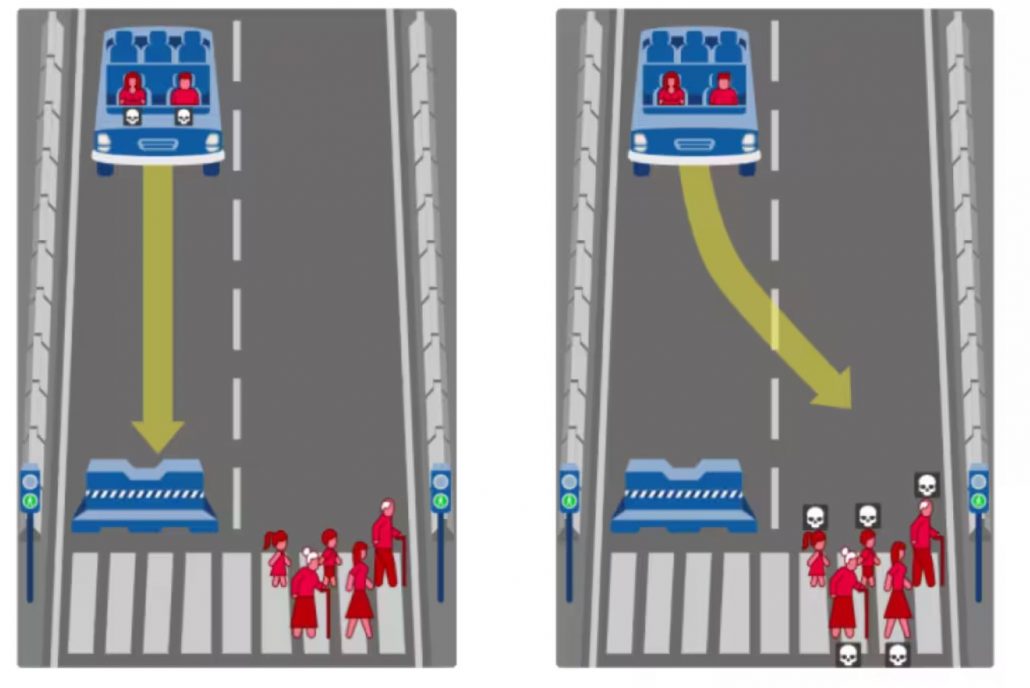

Mettere sotto i pedoni salvando i passeggeri o uccidere i passeggeri per salvare i pedoni?

E se i pedoni stessero passando col rosso, avrebbero più o meno diritto di vivere?

E se fossero tutti anziani o tutti di bambini? Dovrebbe cambiare la decisione?

Ah, cara la mia AI: ne hai di polenta da mangiare prima di confrontarti col mondo reale!

La strada, così com’è ora, non è un mondo stabile: possono accadere troppi imprevisti, quindi diffidate di chi promette auto completamente autonome a breve…

Le AI non ci vedono gran che

Le favoleggiate capacità di riconoscimento “visivo” degli oggetti da parte delle AI ha dei limiti enormi, che nel caso ad esempio della guida autonoma sono un problema non aggirabile.

Partiamo da una concetto semplice da capire: un’AI non “vede” un bel niente.

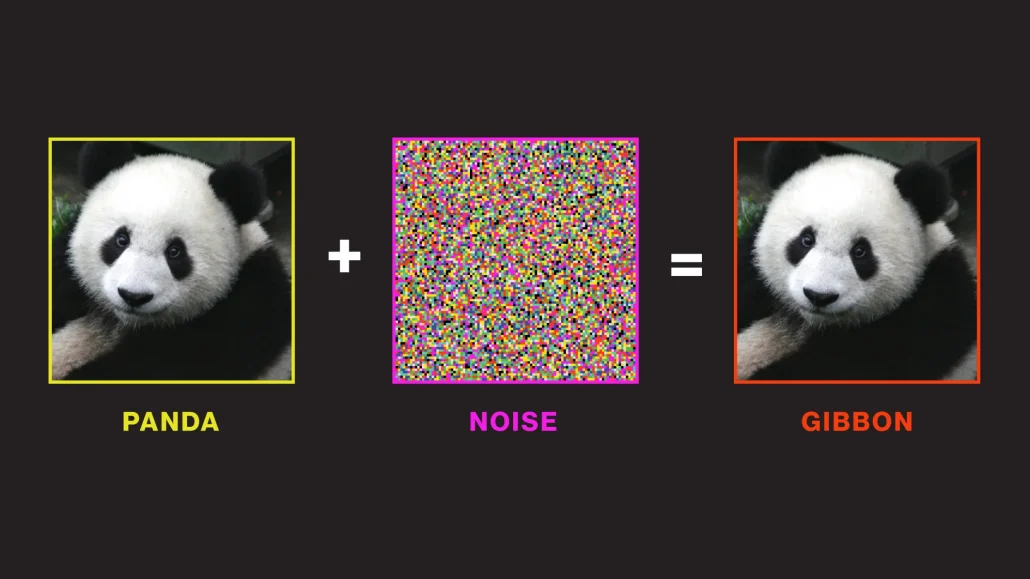

Un’AI analizza un input, cioè una serie di 0 e di 1, in cui un’immagine è stata tradotta dall’acquisizione digitale. Compara le caratteristiche di quell’input con gli altri che “ha acquisito” e stabilisce, su base probabilistica, se quell’immagine ritrae ad esempio “un autobus” o “una mucca”.

Esperimenti condotti in questo senso hanno mostrato che sistemi avanzatissimi di Deep Learning prendono delle cantonate pazzesche nel riconoscimento di un oggetto in un’immagine, solo variando qualche pixel nell’immagine.

Pensate se, durante la guida, l’AI scambiasse un bambino con un sacchetto e valutasse che travolgerlo è più conveniente che schivarlo.

Qui un approfondito, complicato, ma molto interessante documento sull’argomento >>> https://arxiv.org/pdf/1312.6199.pdf

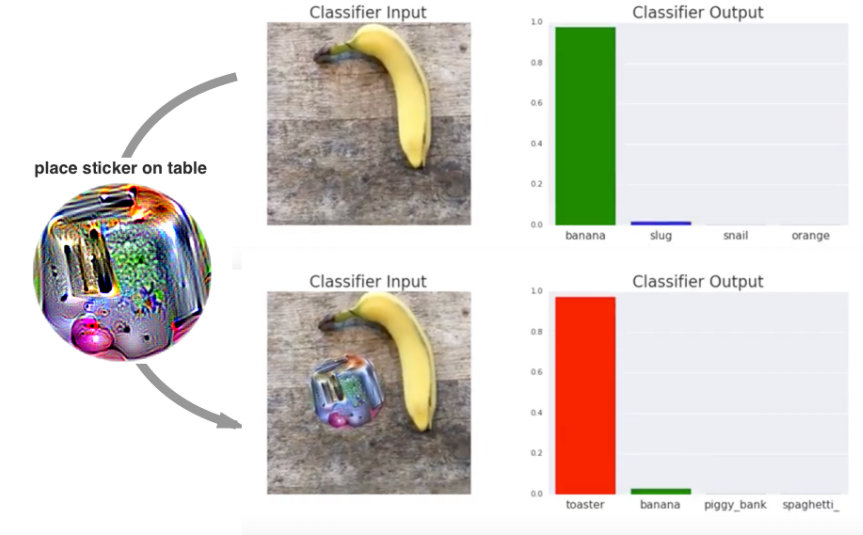

Addirittura sono state identificate particolari macchie che sono in grado di confondere buona parte delle RNP (Reti Neurali Profonde, le AI più avanzate esistenti) durante il riconoscimento, anche in scenari in cui la macchia copre solo l’1% dell’immagine totale.

Qui il riferimento alla ricerca condotta dal Max Plank Institute >>> https://arxiv.org/pdf/1910.10053.pdf

Essere travolti per strada perché qualcuno ha appiccicato uno sticker su un segnale di STOP sarebbe agghiacciante, non credete?

Con buona pace di Asimov e delle sue Leggi della Robotica.

Un’AI non pensa

Perché l’AI sbaglia in modo così grossolano nel riconoscimento delle immagini? E’ un problema di com’è programmata? No, è che non è un cervello umano e non ci assomiglia neanche da lontano, sebbene la terminologia indichi il contrario.

Semplicemente, un’AI non concettualizza, non sa pensare.

Come il nostro cervello riesca a farlo è uno di grandi misteri che gli scienziati non sono ancora riusciti a capire fino in fondo… e forse non hanno neanche scalfito la superficie della questione.

In che modo possiamo quindi “insegnare” ad un’AI a fare qualcosa che nemmeno noi sappiamo, materialmente, come riusciamo a fare? Come tradurre in algoritmi qualcosa che esiste nel nostro cranio ad un livello di profondità e complessità che noi per primi non siamo in grado di comprendere?

Un’AI non ha il concetto astratto di “scuolabus” o di “cane” o di “bambino”. Persino su operazioni banali come riconoscere uno scuolabus, se io lo vedessi “blu” anziché “giallo”, lo riconoscerei come tale. Un’AI no. Potrebbe scambiarlo per tutt’altro, come un tostapane!

Un’AI non sa che sta giocando a scacchi, non comprende nemmeno di avere di fronte “un avversario”: usa semplicemente la forza bruta dei calcoli per raggiungere un risultato.

E’ intelligenza, questa?

In conclusione

Negli scenari da “mondo stabile” in cui bisogna solo fare calcoli, un’AI è estremamente efficiente, persino superiore all’essere umano.

Quando intervengono capacità umane, è decisamente nei guai.

Capire i limiti di queste tecnologie è importante: non si deve fare l’errore di delegare alla cieca ad un sistema informatico la capacità decisionale credendo che sia in grado di pensare, soprattutto in ambiti che attengono direttamente alla vita delle persone. D’altra parte non bisogna neppure demonizzarne l’uso.

Lo sviluppo di queste tecnologie è paragonabile a quello dell’energia nucleare: ci possiamo fare bombe o possiamo usarla come fonte energetica, sempre avendo cura di monitorarne il funzionamento ed i rischi. Quando Elon Musk strilla sul fatto che bisognerebbe interromperne lo sviluppo credo sia più preoccupato dell’uso deviato della tecnologia che non del fatto che ci soppianterà tutti.

Potrei anche chiedermi, in modo un po’ cattivello, se questa richiesta di stop non derivi in realtà dal fatto che sono indietrissimo sui progetti di guida autonoma promessi da anni ma fallimentari (per le ragioni espresse sopra).

Il problema non è la tecnologia ma è l’uso che se ne fa e soprattutto è importante chiedersi quale sia il vero scopo di chi la usa e la promuove. Al solito, il problema non è la scoperta scientifica in sé: sono gli esseri umani che poi ne fanno uso per scopi non trasparenti. Per non dire di peggio.

Su questo punto, ad ognuno la libertà di fare le riflessioni che ritiene più opportune e decidere di conseguenza: noi, a differenza delle AI, possiamo farlo.

Elena Iseni

Mkt e Communication Nubys